可灵AI全系模型上线“视频音效”功能 可同步生成高质量立体声音效

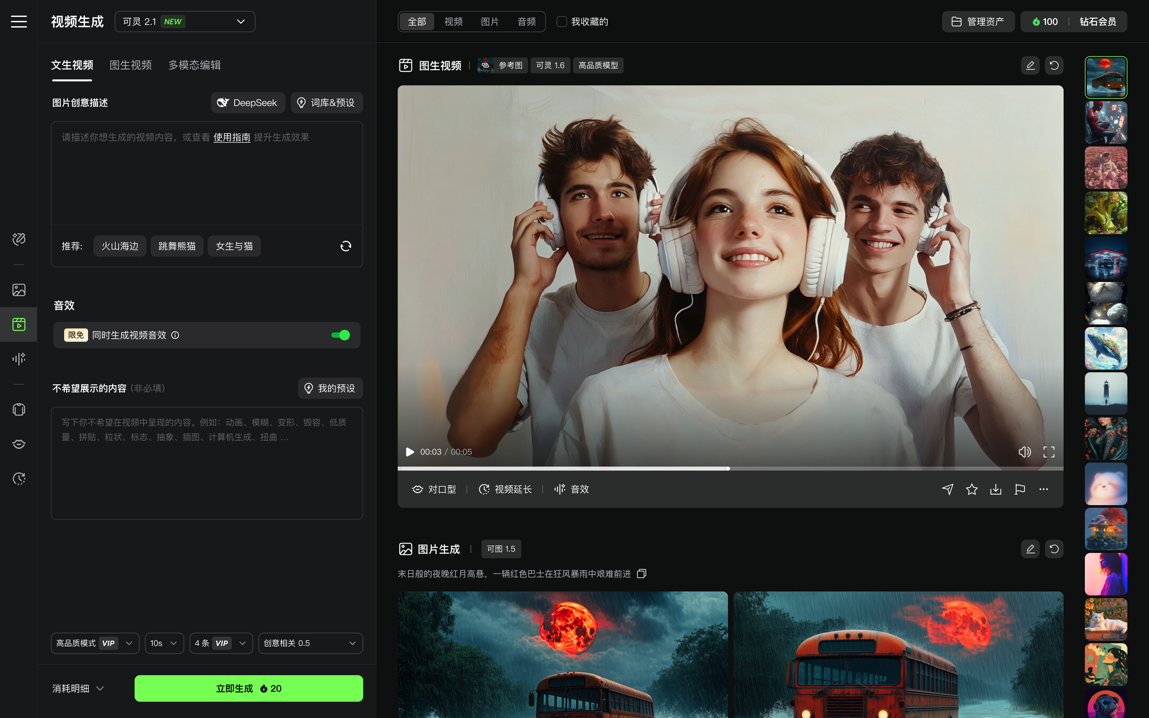

6月27日,可灵AI宣布全系列视频模型上线“视频音效”功能,用户在使用可灵AI进行视频创作时,不仅能获得高质量的视频画面,更能体验到与视频精准匹配、富有空间感的立体声音效,真正实现“所见即所听”的沉浸式体验。目前,该功能已无缝集成至文生视频、图生视频、多模态编辑等多种创作模式中,并限时免费开放。

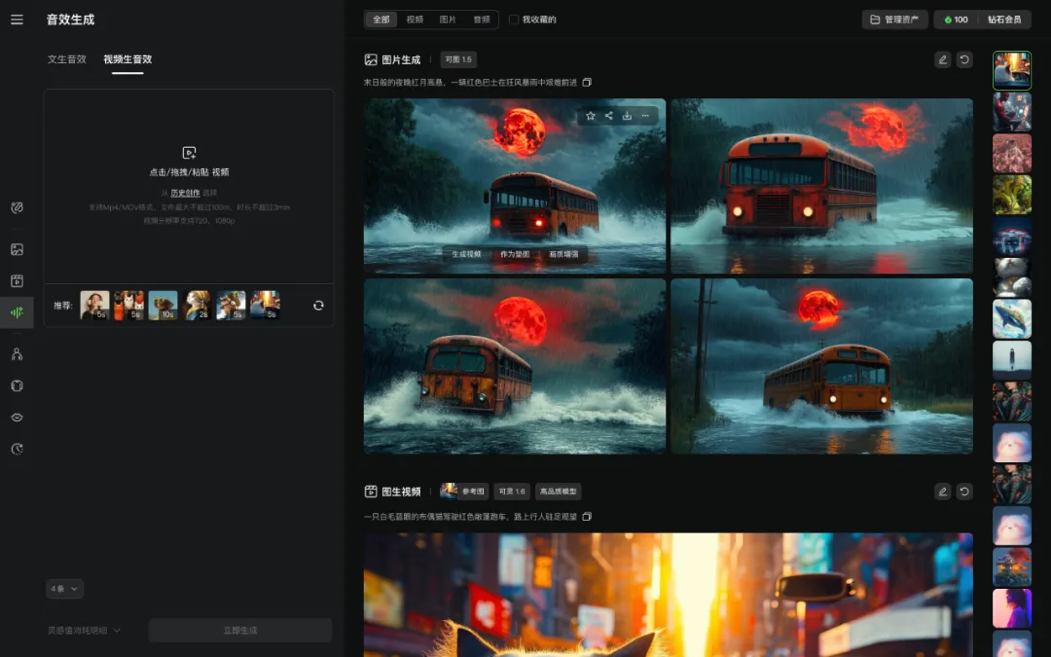

与此同时,平台原有的“音效生成”也进一步升级,新增“视频生音效”功能。用户现在不仅可以通过文本生成音效,更可以直接上传本地视频,或选用在可灵平台创作的历史视频,一键为无声的画面匹配上语义契合、节奏同步的音效,自动适配动作、环境、氛围等多种场景,极大地提升了视频内容的表现力和沉浸感,有效降低了创作者在音频后期制作上的时间与技术成本。

从实际效果来看,可灵AI的音效功能在多个典型案例中展现了极高的音画同步精度和极佳的空间听感。例如,在生成“婴儿在活泼地笑”的视频片段中,模型不仅还原了婴儿清亮的笑声,甚至连婴儿笑容间隙短促的吸气声都完美捕捉,与画面中肉嘟嘟脸颊的起伏动作精准匹配,其富有空间感的立体声效果,让整个画面的温馨感与生命力扑面而来。

在另一段山体滑坡导致巨石砸中汽车的视频中,系统自动生成了金属扭曲断裂声、石块飞溅与尘土扬起的细节音效,声音定位清晰、动态层次丰富,提升了整体灾难场景的视觉冲击力与沉浸感。

据悉,上述功能的实现,依托于可灵AI自主研发的多模态视频生音效模型——Kling-Foley。Kling-Foley 支持基于视频内容与可选文本提示自动生成与视频画面语义相关、时间同步的高质量立体声音频,涵盖音效、背景音乐等多种类型声音内容。它支持生成任意时长的音频内容,还具备立体声渲染的能力,支持空间定向的声源建模和渲染。

今年3月,可灵AI首次推出AI音效功能,用户可通过输入文本生成相应的环境音或动作音,并可进一步结合平台生成的视频进行语义理解与自动匹配。随后,在可灵2.1模型中正式加入了视频音效功能,在生成视频的同时,系统也会自动生成与之匹配的音效,增强了整体视听体验。随着视频音效生成技术的成熟落地,将进一步释放可灵AI在广告创意、影视、短视频、游戏等内容等领域的发展潜力。

相关阅读

- 零跑C10获第四个世界级设计大奖——美国IDEA设计奖

- 首个AI智能体落地西湖:比利信息用AI重构游客体验与景区增长逻辑

- 高通中国公司减资至4.8亿美元

- 温州园博会雕塑创意赛落幕,以雕艺绘就艺术生态交融画卷

- 擦窗机器人哪个品牌好?2026擦窗机器人品牌排名

- 2025小折叠评测:什么手机最好用答案已经揭晓

- AWE2026 重磅发布:凯迪仕i60 Ultra登场,京东战略合作共筑 AI 智能锁新高度

- A级SUV新王炸!比亚迪全新海狮05全新震撼发布,官方售价9.79万元-14.59万元

- 中国谷神星一号遥九运载火箭发射成功!民营火箭首次晨昏轨道发射

- 雷军宣布:小米汽车工厂2025年起逐步开放参观,每次限20人