新西兰推动立法,拟禁止 16 岁以下未成年人使用社交媒体

2024年底,澳大利亚通过了一项全球首创的法律:禁止16岁以下未成年人使用社交媒体平台。这一法案迅速引发国际关注,而作为邻国的新西兰也正在积极讨论是否跟进类似政策。

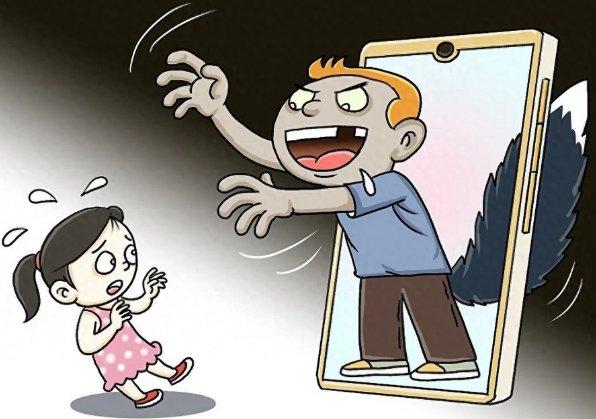

作为一名长期研究数字健康与青少年心理的科技从业者,我深知社交媒体的双刃剑效应。Meta(Facebook、Instagram)、TikTok、Snapchat等平台虽然提供了连接世界的窗口,但也带来了网络成瘾、隐私泄露、网络霸凌等问题。新西兰政府此次的立法动向,无疑是对这一现象的严肃回应。

2为何要禁止未成年人使用社交媒体?

近年来,多项研究表明,社交媒体的过度使用与抑郁、焦虑、自卑感等心理问题高度相关。例如:

Meta内部研究(2021年泄露文件)显示,Instagram对青少年女孩的负面影响尤为严重,32%的受访者表示该平台加剧了她们的身材焦虑。

新西兰心理健康基金会(2023年报告)指出,15-19岁青少年中,因社交媒体引发的心理问题就诊率上升了40%。

社交媒体平台依赖AI推荐算法,通过无限滚动的信息流、短视频等形式,不断刺激多巴胺分泌,使未成年人难以自控。TikTok的“For You”页面就是一个典型案例——它的设计初衷就是最大化用户停留时间,而非促进健康的信息消费。

未成年人的数据保护尤为关键,但现实是:

•Snapchat的“Snap Map”**曾因暴露用户实时位置而引发安全争议。

Meta因违反欧盟《通用数据保护条例》(GDPR)**被罚款12亿欧元(2023年),其中涉及未成年用户数据的违规收集。

目前,新西兰政府正在讨论的立法可能包括:

禁止16岁以下未成年人注册社交媒体账户(需年龄验证)。

要求平台采用更严格的AI内容过滤,减少有害信息(如自残、极端饮食内容)。

对违规平台处以高额罚款(类似欧盟《数字服务法》的监管模式)。

奥克兰大学高级研究员Dr. Sarah Miller指出:“这项立法并非‘一刀切’,而是希望推动更健康的数字环境,就像我们限制未成年人吸烟、饮酒一样。”

面对全球监管压力,科技巨头已经开始调整策略:

Meta推出“青少年保护模式”,限制广告定向投放。

TikTok试点“60分钟每日使用上限”(需家长设置)。

Apple在iOS 17中强化“屏幕使用时间”功能,帮助家长管理设备使用。

但问题在于:这些措施是否足够? 从目前的反馈来看,被动式调整(如“家长控制”)效果有限,真正的改变可能需要立法强制+技术创新的双重推动。